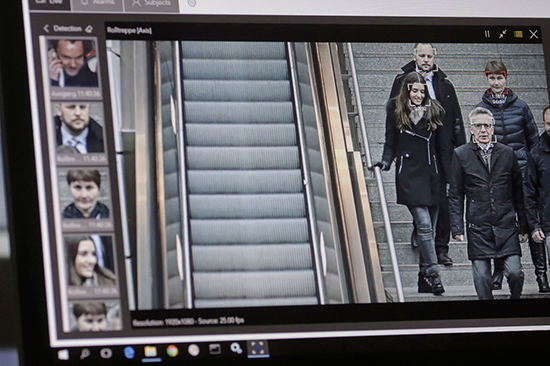

地鐵或采用人臉識別,,你在“白名單”里嗎?

去年4月,,江西省南昌國際體育中心,張學友舉辦了一場演唱會,,現(xiàn)場約有六萬粉絲,。演唱會開始沒多久,警察來到中心看臺帶走了一名男子,。據(jù)警方介紹,,男子是一名在逃嫌犯。為了看張學友,,前一天上午他和妻子朋友們驅(qū)車近100公里,。在一場萬人演唱會上,他以為不會有人注意到他,。

確實,,在6萬人中鎖定一個目標不容易,但對AI來說,,不是問題,。

人臉識別技術(shù)的本事可不止是抓逃犯。在我國,,人臉識別技術(shù)至少進入安防,、金融,、交通、零售,、醫(yī)療,、校園等多個領(lǐng)域。這項AI技術(shù)給用戶帶來便捷,,給各行各業(yè)帶來了實實在在的推動甚至是變革,。

阿里巴巴的螞蟻金服利用“微笑支付”功能,讓用戶在肯德基點餐更便捷,;

杭州一所高中以此技術(shù)監(jiān)控學生出勤率,;

深圳以及其他城市的交警則以之鎖定亂穿馬路的行人和自行車;

北京天壇附近一處公園,,將該技術(shù)應用于公廁,,以防止游客盜竊廁紙。

北京的地鐵可能也要采用人臉識別技術(shù)了,。

有消息稱,,北京或?qū)⒔⒌罔F“白名單”及快速安檢通道制度,通過應用人臉識別技術(shù),,乘客“刷臉”即可快速通過安檢通道,。

據(jù)稱,此舉能提升安檢效率,、精準識別可疑乘客,、降低地鐵安檢成本、增強對犯罪分子的震懾力,。

這項看上去合情合理的舉措,,卻引發(fā)了不少擔憂。

有人設想了一下未來北京地鐵的情形,。

早高峰時期,,“白名單”乘客有序地通過無安檢或者不嚴格安檢的通道,比之前確實快多了,。而有少數(shù)乘客——或許是因為沒有去申請進入白名單,,或許是真的沒通過白名單申請——他們需要去到另一個隊列,接受嚴格的安檢,。半個月之后,,網(wǎng)上開始有人呼吁為“可疑”乘客設置單獨的地鐵車廂,因為和他們乘坐同一車廂,,感覺隨時有危險,。

光明網(wǎng)評論員在“別把人臉識別技術(shù)搞成現(xiàn)代‘刺黥’”一文中,就此事提出質(zhì)疑:“一個人即使是涉嫌犯罪或涉違約侵權(quán),其有罪與否,、違約侵權(quán)與否,,都要經(jīng)過法庭的公開審理才可定論。審理期間,,公訴人與律師,、原告和被告之間,都要對各自的證據(jù)進行質(zhì)證,,而后經(jīng)庭審法官依法判定,,即使這樣,還不能避免冤錯案件,。而應用人臉識別技術(shù)對乘客實施分類,,則是公民被一個設備看了一下臉,在無知情況下就被定類,。這,,可行嗎?”

有偏見,,與你無關(guān)

人臉識別可能帶來的歧視和偏見,,已經(jīng)引發(fā)擔憂了。究其原因,,一是源于AI技術(shù)本身,,一是源于該技術(shù)被不當使用。

誰說AI是中立的

軟件公司Salesforce的首席科學家理查德?佐赫爾在《財富》國際頭腦風暴科技大會上指出:“偏見將成為未來人工智能領(lǐng)域里的一個根本性問題,?!?/p>

顛覆認知的是,,大規(guī)模的數(shù)據(jù)收集與分析并不代表能產(chǎn)生客觀中立的觀點,,反而有可能加深先前存在的偏見。

如果一家銀行使用社交媒體來預測某人拖欠貸款的可能性,,或是警方依賴預測模型來決定將哪類人列為嫌疑對象,,那么從數(shù)據(jù)中發(fā)現(xiàn)的任何種族、性別或階級偏見都可以反映出來,,并且可能被這些模型放大,,從而產(chǎn)生帶有歧視性的結(jié)果。

再具體一點說,。比如有人發(fā)現(xiàn),,一些人臉識別系統(tǒng)在識別深膚色和淺膚色人臉時,精確度往往不高,,原因是用于訓練該系統(tǒng)的深膚色人臉數(shù)據(jù)遠遠不足,。最臭名昭著的一個例子是,美國部分州的司法部門使用了一套人臉識別系統(tǒng),用來決定是否應該批準犯罪嫌疑人保釋或假釋,。然而在犯罪記錄相似的前提下,,系統(tǒng)卻認為黑人嫌犯比白人嫌犯有更高的再次犯罪風險。

佐赫爾認為,,在構(gòu)建人工智能系統(tǒng)的人自身變得更加多元化之前,,有些類型的偏見是不太可能被徹底消除的。目前,,很多從事人工智能軟件開發(fā)的計算機工程師都是白人,,而且當前開發(fā)的很多人工智能軟件都只反映了城市富裕人口的需求。

有爭議的應用場景

正如美國蘋果CEO庫克所說:“技術(shù)本身沒有好與壞,,一切由我們?nèi)藖頉Q定”,。讓我們感到害怕的不是人臉識別技術(shù)本身,而是其被過度,、不當?shù)膽谩?/p>

今年9月,,一段運用人臉識別技術(shù)來監(jiān)控學生的視頻,在網(wǎng)上引發(fā)了熱議,。

“趴桌子2次,,玩手機2次,睡覺1次,,聽講0次,,閱讀0次,舉手0次,,笑了0次,,厭惡表情出現(xiàn)了10次……”

這項被稱作是能夠?qū)崿F(xiàn)對學生“精準監(jiān)控”的技術(shù),在網(wǎng)絡上迅速引發(fā)了爭議,。有網(wǎng)友指出,,“學校應該是個培養(yǎng)人的地方,而正常人就應該有喜怒哀樂興奮懈怠開懷懶倦的情緒不是嗎,?”

這條視頻出自AI獨角獸公司曠視科技,,事發(fā)當晚該公司發(fā)出聲明稱:“近日網(wǎng)絡上出現(xiàn)的一幅課堂行為分析圖片,為技術(shù)場景化概念演示,。曠視在教育領(lǐng)域的產(chǎn)品專注于保護孩子在校園的安全,。”

但在同一天,,剛剛開學的某高校同學們發(fā)現(xiàn),,校門口、學生宿舍門口,、圖書館,、實驗樓,、教室里多了很多的人臉識別攝像頭。所用設備就是曠視科技的產(chǎn)品,。

危險的臉歧視并不是最可怕的,,在一些時候,人臉識別技術(shù)被認為具有危險性,。

《經(jīng)濟學人》刊發(fā)于2017年的報道提出,,人臉本身存在特殊性,“人臉和其他生物特征數(shù)據(jù),,比如和指紋之間存在一個巨大區(qū)別是,,它們可以遠距離起作用。任何人只要有手機都能拍攝一張照片供人臉識別程序使用,?!?/p>

因此人臉面部特征有著更為廣闊的運用前景,隨之而來的是更高的風險,。

還記得前不久,,一款名為“ZAO”的AI換臉軟件突然火爆全網(wǎng)吧?上線當晚就直接沖到了App Store的第二名,??梢哉f這款軟件說把用戶想要體驗的AI換臉門檻降到了最低。但隨著ZAO越來越火,,用戶們對它的質(zhì)疑聲也變得越來越大,。

我們來看看它的用戶協(xié)議。該項條款包括但不限于:人臉照片,、圖片,、視頻資料等肖像資料中所含的用戶或肖像權(quán)利人的肖像權(quán),以及利用技術(shù)對其肖像進行形式改動,。

這也就意味著,,如果你簽了該協(xié)議,你就在無形中將自己的肖像權(quán)拱手讓人了,,以后你的臉將完全有可能被別人隨意使用,,變換。

其實早在2017年12月,,國外某ID名為“deepfakes”的Reddit論壇用戶首次將自己制作的AI換臉視頻發(fā)布在了網(wǎng)絡上,它能夠把照片和視頻中的人臉替換成任何想要替換的人臉,,且效果十分逼真,,有些肉眼甚至難以分辨真假。

當時,,“deepfakes”把情色電影里的女主角換成了蓋爾?加朵等好萊塢明星,,這也是世界上所有人們第一次公開見識到AI換臉的強大——和危險。

市場調(diào)研公司Market Research Future稱,人臉識別市場每年增長20%,,預計到2022年將達到每年90億美元,。

開發(fā)頂尖軟件的競爭中,勝出的公司必然要算法精確度很高,,可以迅速識別面部,,盡量減少誤差。與人工智能其他領(lǐng)域一樣,,要開發(fā)出最好的面部識別算法,,就得收集大量數(shù)據(jù),也就是面部圖像用來訓練,。

“收集并分析這些數(shù)據(jù)是有許多益處的,。”凱洛格學院的一位營銷學副教授卡特勒說道,?!叭欢娘L險也很大,因為同樣的信息也能夠被惡意使用,?!?strong>而即便是出于最大的善意研究這些數(shù)據(jù),它們依然有可能產(chǎn)生預料之外的負面副作用,。

為了改進算法,,很多公司經(jīng)常在未經(jīng)許可的情況下利用數(shù)十億張面部照片來進行算法訓練。你自己的臉就可能在面部識別公司的“訓練庫”里,,也可能在公司客戶的數(shù)據(jù)庫里,。

最近,美國國家廣播公司的一篇報道重點批評了類似做法,,道詳細描述了IBM如何從照片共享網(wǎng)站Flickr中抓走超過100萬張面部照片,,用作人工智能研究。

此外也存在黑客攻擊的風險,。網(wǎng)絡安全公司Gemini Advisors的安德雷?巴雷舍維奇說,,曾經(jīng)見過從印度國家生物特征數(shù)據(jù)庫中竊取的資料,都在“暗網(wǎng)”上出售,。他還沒發(fā)現(xiàn)有人出售美國人面部數(shù)據(jù)庫,,但補充說,“這只是時間問題,?!比绻l(fā)生這種情況,從酒店或零售商盜取的顧客面部圖片可以幫助罪犯實施詐騙或冒充身份,。

我們是否太寬容

數(shù)據(jù)泄露和數(shù)據(jù)嚴重濫用通常會引發(fā)消費者的強烈抗議,。然而,我們實際上對數(shù)據(jù)濫用的容忍度也讓人意外,。

人臉識別公司FaceFirst的特雷普說:“80,、90后更愿意提供面部圖像?!渡贁?shù)派報告》里呈現(xiàn)的世界即將到來,。如果做得好,人們將享受到便利,,而且將變成積極的經(jīng)歷,。不會感覺太古怪?!?/p>

那么問題來了:是否越來越多的人愿意用隱私來換取便利,?他們都知道背后的風險么?監(jiān)管部門是否能扮演保護者的角色,?

喬治敦大學的研究員加維支持由法律監(jiān)督該項技術(shù),。但她也表示立法者很難跟上技術(shù)發(fā)展的腳步:“跟指紋不一樣的是,長期以來指紋采集的方式和時間一直有規(guī)則限制,,而面部識別技術(shù)領(lǐng)域沒有規(guī)則,。”

很多情況下,,消費者沒有意識到自己在巨大數(shù)據(jù)集的正式與非正式研究中扮演“參加者”的角色,。

在注冊獲得一項免費服務,或申請信用卡時,,“大多數(shù)人都不知道自己同意了哪些事項,,也不知道他們的數(shù)據(jù)會被用來做什么?!?凱洛格學院的卡特勒教授說,。“他們或許會感到不安,,但對于他們的數(shù)據(jù)會被如何使用,,以及可能帶來的損害則無了解?!?/p>

大多數(shù)人除了接受伴隨新技術(shù)的益處而來的弊端之外別無選擇,,因為拒絕的成本往往太高。

不能缺席的法律法規(guī)

很多人開始警惕人臉識別技術(shù)的濫用,,“反人臉識別”技術(shù)也開始涌現(xiàn),。比如“腦門貼紙”——穿戴繪制特定圖案的眼鏡、帽子,、衣服能夠有效干擾機器視覺,,避免算法對人的識別。

當然,,這并非是理想的解決方案,。

中國清華大學法學教授勞東燕在其公眾號發(fā)文稱,有必要對人臉識別進行法律規(guī)制,。勞東燕主闡述了四點原因,,一是人臉是重要的個人生物數(shù)據(jù),相關(guān)機構(gòu)或組織在收集之前需證明合法性,;二是需征求公眾意見,,經(jīng)過嚴格的聽證過程;三是驗證分類標準的合理性和合法性,;四是驗證人臉識別技術(shù)的通行效率,。

法學博士史宇航稱,在我國正在制定的“民法典人格權(quán)編”草案二審稿中,,就將面部特征等個人生物識別信息納入個人信息的范疇,。除此以外,面部特征還涉及肖像權(quán)的保護問題,,是傳統(tǒng)法律關(guān)系與新興法律關(guān)系的碰撞與融合,。圍繞面部特征等個人信息的收集、利用,,各國法律大多是以用戶的“知情-同意”作為合法的基礎,。

美國已經(jīng)有多個城市制定了與人臉識別數(shù)據(jù)相關(guān)的法案,禁止人臉識別技術(shù)的使用,。

英國警方因為使用人臉識別技術(shù),,被認為侵犯了隱私而被告上法庭。這也是英國首宗因人臉識別技術(shù)而起的法律訴訟,。

加拿大隱私專員辦公室已在調(diào)查商場使用面部識別技術(shù)的合法性問題,。

2019年8月,瑞典數(shù)據(jù)保護機構(gòu)對瑞典一所中學因違反通用數(shù)據(jù)保護條例而判處2萬歐元罰款,。中學工作人員在一個教室里面安裝了一部人臉識別相機作為實驗,,以檢測采用此種方式登記學生考勤是否更為迅速,該實驗共涉及22名學生,。瑞典數(shù)據(jù)保護機構(gòu)認為中學征得的同意不是“自由作出的”,,并且不符合最小必要性原則,。